矿用振动筛

选煤、矿石筛选及分级

大数据算法歧视已经悄无声息地到来。这次中招的是被微博判定为机器人的男性,下次呢?

“ IG 赢了!”不管你玩不玩在线游戏,近期可能都看到类似消息在刷屏。11月3日,中国电竞战队 IG 在2018年英雄联盟全球总决赛上取得冠军,创下中国大陆战队七年来的最好成绩。

在游戏爱好者们的一派“喜大普奔”之中,IG 老板王思聪也进场庆贺,宣布通过微博抽奖送出百万现金。这一下又炸出不少围观群众:首轮抽奖微博11月6日发出至开奖,共计获得约2728万转发、2006万评论和1979万点赞。

11月11日,随着“王思聪开奖”和“王思聪中奖名单”登上微博热搜,开始有细心网友感到中奖名单不合理:

中奖的113人中,竟然有112人都是女性?这似乎不太符合游戏爱好者的男女分布比例。

接着,许多博主反映称,他们以往组织过的抽奖活动中,也出现了“中奖用户多为女性”的现象。

例如,粉丝数超过260万的微博大V“@江宁婆婆”提到,近期三盒大闸蟹和十多个书签手账的中奖者全是妹子。粉丝数500多人的博主“@鱼塘三万顷”则说,近期抽奖给了5个名额,只有4个转发,结果开奖时抽了三个妹子,把男生刷掉了。“就是不抽男号呢”,“@鱼塘三万顷”感叹道。

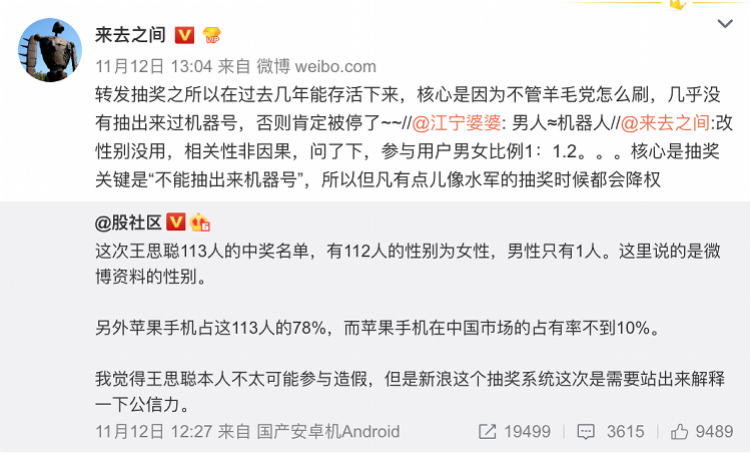

由此,网友们纷纷质疑微博的抽奖规则有猫腻。“我觉得王思聪本人不太可能参与造假,但是新浪这个抽奖系统这次是需要站出来解释一下公信力。 ”一位财经博主在微博提出质疑,获得近2万次的转发。

11月12日,微博 CEO 王高飞“@来去之间”作出回应,否认微博抽奖规则偏向女性。针对网友们纷纷戏谑要改性别的举动,他直言,“改性别没用,相关性非因果”。

王高飞透露,参与王思聪微博抽奖的用户,男女比例为1:1.2。之所以出现大量女性用户中奖,是因为微博抽奖规则的关键是“不能抽出来机器号”。“

所以但凡行为有点儿像水军的(比如只转发从来不原创,没发过图,等等等等)抽奖时候会降权,女生一般行为更活跃,男的只看不说话,是比较吃亏。“王高飞在微博回应中说。

所谓“机器号”,就是那些靠自动程序注册、被人为操纵的微博账号。这些账号构成的“水军”和“僵尸粉”在微博大量存在,被用来制造虚假的转发、评论或是抽奖“薅羊毛”,严重影响微博的正常生态。因此,机器号一直是微博重点打击的对象,用户也对此习以为常。

只是,让用户万万没想到的是,微博抽奖平台会过滤机器用户,并对疑似机器用户的人进行降权——

如果平时不够活跃、原创微博发得不够多,用户就会在各类抽奖活动中被当做“垃圾用户”过滤掉,白白当了抽奖人数的分母。

王高飞解释过滤规则后不久,博主“@蚁工厂”做试验,发布了一条中奖名额有2万人的微博。结果显示,测试微博获得1.5万转发,但只有9000多人中奖。“我是垃圾用户。”“看来年费会员也没用啊。”大量真人用户在这条微博下留言。

隐私护卫队梳理发现,让网友感到不舒服的地方主要有三点。第一,微博抽奖平台并没有对过滤规则进行充分告知,很多用户兴冲冲地前去抽奖,却不清楚自己很可能被识别为“垃圾用户”。

第二,过滤规则可能有违公平。“广告没少给我们看,抽奖的时候就粗暴的把我们定义为机器号。”“@丁小滨”吐槽道。“如何界定羊毛党是你司的职责,没解决之前你可以不上线啊,抽奖转发给你引流了可本质每个用户的概率都不一样,这事合理么?” “@HighCool_”评论称。

第三点让用户颇有微辞的地方是,面对质疑,微博并没有作出“改进算法以减少误伤的相关表态。王高飞在回应里强调的始终是现行规则的好处,比如“不管羊毛党怎么刷,就没有抽出来过机器号”,对用户提出的问题却基本上避而不谈。

几番讨论后,有网友总结:“抽奖算法是宁可错杀男人,也不能让机器人得逞。”不少人直言,微博是拿着别人(博主)的钱去回馈微博自己的活跃用户,如此“借花献佛”让人难以接受。

不过,也有一些博主对微博的做法表示了体谅。博主“@蚁工厂”就发文称,感觉过滤功能还是有用的,“毕竟抽奖还是想抽给真正的粉丝”。

对于微博不公开抽奖规则和垃圾用户判断标准的做法,“@蚁工厂”认为情有可原,因为一旦公开了算法,机器人就完全可能训练自己去适应算法,最终受害的还是用户。

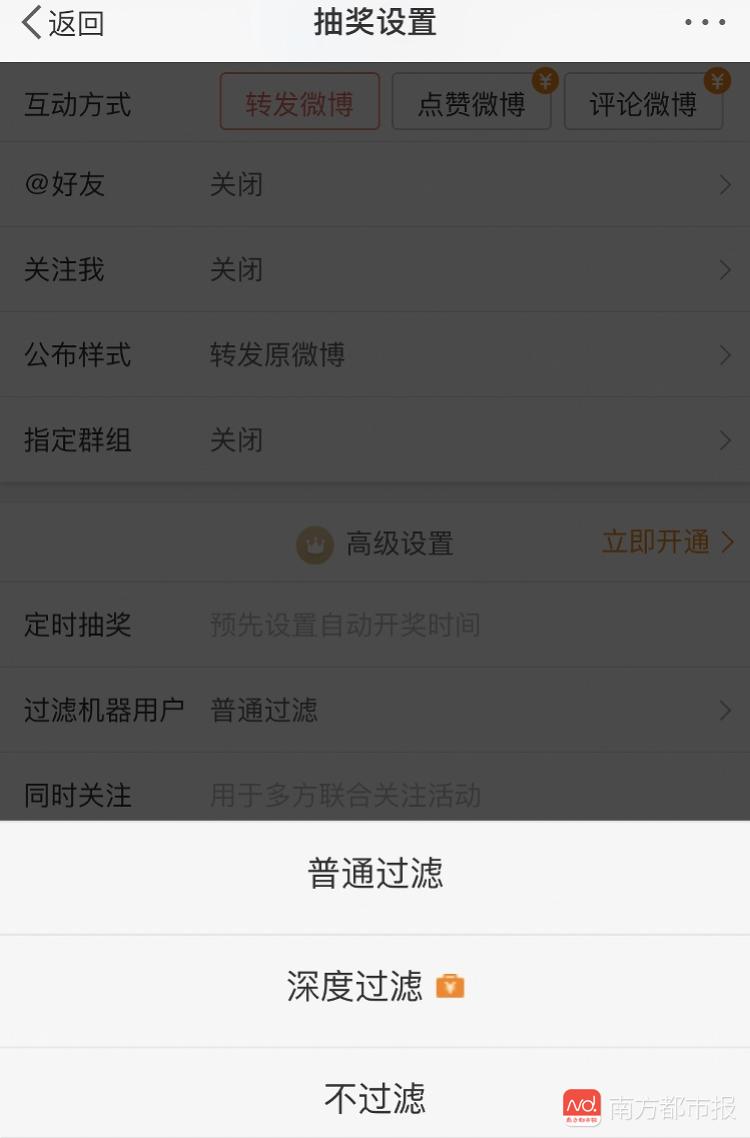

或许是因为此次群众的不满实在太强烈,11月13日,微博终于进行了改进,在抽奖平台设置中增加了“不过滤”选项。除此之外,用户还可以再一次进行选择“普通过滤”和“深度过滤”。

隐私护卫队注意到,很多人在声讨微博之余,开始思考更深层次的算法歧视问题。

中国网友们对算法歧视已然不陌生。此前,相同路线 iPhone 用户打车更贵、会员预定酒店价格更高的案例就广为流传,“大数据杀熟”的说法传得沸沸扬扬。尽管相关平台都跳出来表示坚决没有歧视,却难以让人们感到信服。

在此次微博的案例中,还有许多网友半开玩笑地表示,幸亏被刷掉的大多是男性用户,微博你反过来试试?言下之意,在男女尚未完全平权的当下,微博若是被扣上“性别歧视”的帽子,麻烦就更大了。

事实上,算法性别歧视的现象已然浮现。2017年,弗吉尼亚大学在读博士赵洁玉注意到,她手下的图像识别人工智能总是把一些特定元素与女性联系在一起,比如,把站在厨房里的男人错误地认成女人——在人工智能“眼中”,“做饭”“购物”“洗衣”等都更偏向于女性,“驾驶”“射击”则更偏向于男性。

模型不仅会学习到数据集中的偏差,并且会放大该偏差”。通俗地说就是,AI在学习时发现厨房图片里大多是女人,所以即使看到一张男人在厨房的图片,也会想当然地认为图中是个女人。

类似的例子还有许多,表现也不单单是价格或是性别歧视,甚至包括种族歧视。2013年,哈佛大学博士Latanya Sweeney研究指出,在谷歌搜索中,相比搜索白人的名字,搜索黑人的名字会被更多地引向犯罪记录或者逮捕记录之类的结果。对此,谷歌回应称,所有算法都是基于用户习惯,这样的一种情况并不是谷歌刻意而为之,而是用户长期搜索产生的结果。

人们曾经以为算法决策是更中立、更公平的,但现实证明并非如此。从不爱发微博的大概率是机器人,到喜欢购物、下厨的大概是女人……前述所有案例中的判断,指向的其实都是人类社会存在的固有偏见。而目前,在一切涉及到价值判断的领域,人类都还没有很好的方法让“有样学样”的算法摆脱类似偏见。

对人类文明来说,算法歧视无疑是严峻的挑战。2015年,欧盟数据保护委员会发布了《应对大数据挑战:呼吁通过设计和可责性实现透明性、用户控制及数据保护》,提醒算法可能会引起穷人或遭受更多的歧视。2016年,美国白宫也发布了《大数据报告:算法系统、机会和公民权利》,指出了在信贷、就业、教育和刑事司法领域存在的算法歧视问题。

中国也有学者开始着手研究算法歧视现象,不过目前还没有出自官方的报告。好消息是,人们已经从立法、技术等层面提出了诸多的改善路径,比如在算法模型中时加入“机会均等”的设计,以提升算法的公平性和透明度。

Copyright © 2008-2020 华体会手机矿用振动筛厂家- 华体会手机登录版_华体会手机版赞助曼联04 All Rights Reserved 版权所有 免责声明

网站备案号:豫ICP备09002479号-45